Dziennikarze i politycy najbardziej poszkodowani

Zasada, aby nie wierzyć we wszystko, co widzimy w internecie, nabiera nowego znaczenia dzięki sztucznej inteligencji. — Nie wierz bezkrytycznie w żaden film, który zobaczysz. Nie wierz nawet wtedy, gdy swoim własnym głosem, połączonym z właściwymi ruchami ust, wypowiada się na nim osoba publiczna, która cieszy się autorytetem – ostrzega Ewelina Bartuzi-Trokielewicz z Pionu Sztucznej Inteligencji w NASK, który zajmuje się analizą oszustw typu deepfake.

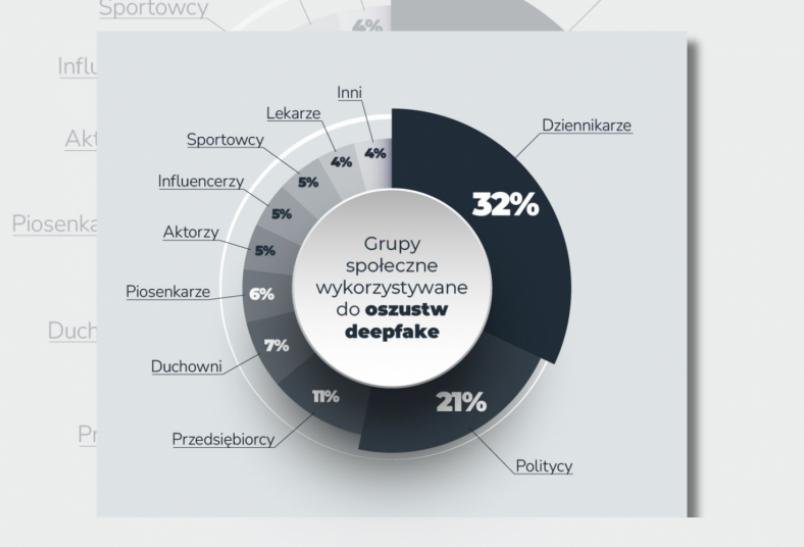

W ciągu ostatnich sześciu miesięcy przestępcy podszywali się pod 121 znanych osób, manipulując ich wizerunkami i głosami. Najczęściej ofiarami są dziennikarze, co stanowi aż 32% wszystkich zaobserwowanych oszustw. — Aktualnie jest już na tej liście ponad 120 pokrzywdzonych osób, głównie ze świata mediów, polityki, kultury i sportu – mówi Joanna Gajewska z NASK z zespołu analizującego deepfake. – To pokazuje dynamikę działań cyberprzestępców i różnorodność oszustw, dopasowanych do innych grup odbiorców – dodała.

Manipulacje deepfake są szczególnie niebezpieczne, gdy dotyczą znanych postaci, takich jak prezydent Andrzej Duda, którego wizerunek został wykorzystany w blisko 9% wszystkich deepfake'ów wykrytych w 2024 roku. Oszuści wykorzystują filmy z jego udziałem, aby promować fałszywe inwestycje finansowe. Filmy te są popularne, ponieważ liczba oryginalnych nagrań z udziałem głowy państwa jest duża, co daje przestępcom bogaty materiał źródłowy. Prezydent Duda zajmuje wysokie miejsca w rankingu zaufania i pełni najważniejszą funkcję publiczną w Polsce, co zwiększa wiarygodność oszustw.

Inne znane postaci również padają ofiarą przestępców. W lipcu najchętniej podszywali się pod premiera Donalda Tuska, a w czerwcu odnotowano najwięcej filmów z wizerunkiem Rafała Brzoski, prezesa InPost. W maju dominowały przeróbki wideo z influencerem Kamilem Labuddą (Buddą), rzekomo namawiającym do mobilnych gier hazardowych. Każda z tych osób cieszy się autorytetem w swojej grupie odbiorców, co oszuści wykorzystują do kierowania swoich reklam.

Dla jednych biskup, dla innych znany aktor

Oszustwa z użyciem filmów deepfake dotyczą również cudownych lekarstw i zabiegów medycznych. W takich przypadkach oszuści szukają autorytetów wśród znanych lekarzy lub trenerów sportowych. Najczęściej jednak manipulują wizerunkami dojrzałych osób, takich jak piosenkarze Krzysztof Cugowski i Maryla Rodowicz, aktorzy Janusz Gajos i Marek Kondrat, a ostatnio także duchowni Kazimierz Nycz, Stanisław Gądecki i Stanisław Dziwisz.

Przestępcy starają się dotrzeć do wszystkich grup społecznych, nawet jeśli ich manipulacje mogą wydawać się komiczne. — Czasami bywa wręcz tak, że wkładanie tych samych słów w usta kolejnych osób, których wizerunki kradną przestępcy, sprawia komiczny efekt. Może to być np. polska dziennikarka, która przedstawia się imieniem i nazwiskiem znanego aktora czy biskupa albo też wysoki hierarcha kościelny, który opowiada, że cudowne lekarstwo pozwoliło mu na bezbolesne spacerowanie z wnukami. Nie chodzi jednak o humor. Tak naprawdę pokazuje nam to, że tworzący te oszustwa fabrykują je taśmowo, często nie umiejąc nawet odróżnić polskich imion męskich i żeńskich albo nie wiedząc, że polskich duchownych obowiązuje celibat. To pośredni dowód na to, że wiele z tych filmów powstaje poza granicami Polski – tłumaczy Michał Ołowski z NASK, również należący do zespołu analizującego deepfake.

Przestępcy nie ograniczają się do fałszywych inwestycji, gier hazardowych czy cudownych medykamentów. Pojawiają się również deepfake'i uwiarygadniające bardziej nietypowe narracje, jak np. przerobione filmy z udziałem funkcjonariuszy międzynarodowej policji zajmującej się ściganiem oszustw internetowych. W rzeczywistości oszuści starają się okraść swoje ofiary po raz kolejny.

Jak walczyć z przestępstwami typu deepfake

Jakość filmów deepfake przygotowywanych przez przestępców wciąż się poprawia. O ile warto umieć rozpoznawać techniczne błędy fałszerstw, o tyle najważniejszą metodą zadbania o własne cyberbezpieczeństwo pozostaje zdrowy rozsądek. Jeśli jakiś przekaz wydaje się zbyt piękny, by był prawdziwy, prawdopodobnie mamy do czynienia z oszustwem.

Wiedza o rosnących możliwościach technicznych przestępców oraz stosowanych przez nich metodach jest najlepszym sposobem obrony. Każda strona z wyłudzającą dane fałszywą platformą inwestycyjną lub cudownym lekarstwem zostanie szybko zablokowana, jeśli zgłosimy ją na Listę ostrzeżeń przed niebezpiecznymi stronami, prowadzoną przez zespół CERT Polska.

Oszustwa deepfake warto zgłaszać poprzez adres [email protected]. Zespół ekspertów z Pionu Sztucznej Inteligencji NASK we współpracy z CSIRT NASK oraz CSIRT KNF rejestruje oszustwa typu deepfake i opracowuje narzędzia do ich automatycznej detekcji